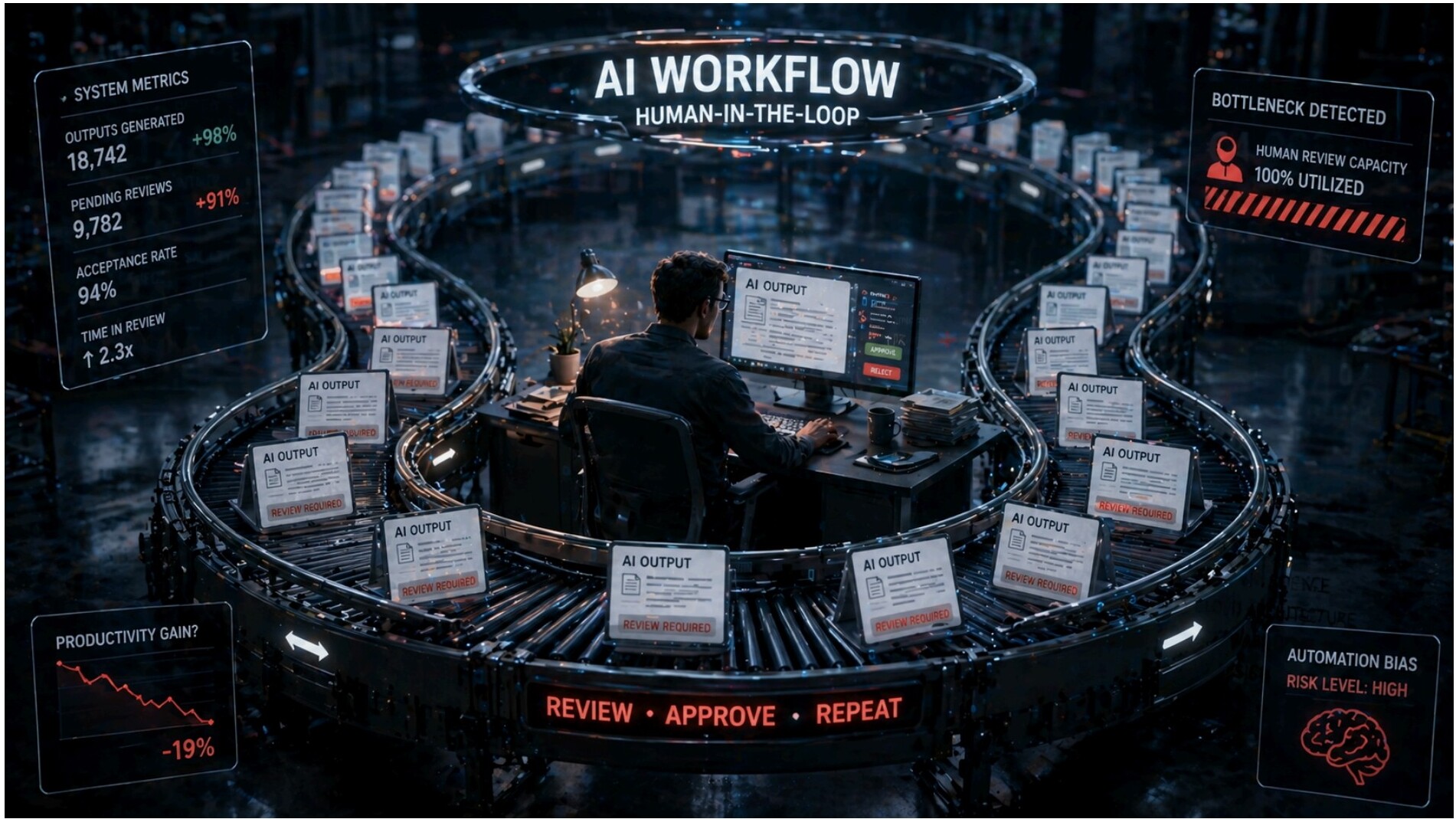

TL;DR Οι περισσότερες startup αναπτύσσουν την AI και στη συνέχεια ενσωματώνουν επίπεδα έγκρισης γύρω από κάθε αποτέλεσμα, με ανθρώπους να ελέγχουν, να επιθεωρούν και να υπογράφουν. Η πρόθεση είναι ο έλεγχος. Το αποτέλεσμα είναι ένα σημείο συμφόρησης που εξαντλεί ακριβώς τα οφέλη παραγωγικότητας που υποτίθεται ότι θα παρείχε η AI. Ένας αυξανόμενος όγκος έρευνας με αξιολόγηση από ομοτίμους δείχνει ότι η αδιάκριτη ανθρώπινη εποπτεία εισάγει μεροληψία αυτοματισμού, διογκώνει τον φόρτο εργασίας των επιθεωρήσεων και υποβαθμίζει την κρίση της ομάδας που υποτίθεται ότι προστάτευε. Αυτό το άρθρο εξηγεί γιατί η παγίδα λειτουργεί με αυτόν τον τρόπο, τι λένε τα δεδομένα και ποια είναι στην πραγματικότητα η επιχειρησιακή λύση.

Τι είναι το μοντέλο Human-in-the-Loop και γιατί το επέλεξαν όλοι ως προεπιλογή;

Το Human-in-the-loop (HITL) είναι ένα σχεδιαστικό πρότυπο στο οποίο ένας άνθρωπος επιθεωρητής παρεμβάλλεται σε ένα ή περισσότερα σημεία μιας ροής εργασίας που καθοδηγείται από AI. Η AI παράγει ένα αποτέλεσμα, ένας άνθρωπος το επικυρώνει και στη συνέχεια προχωρά.

Θεωρητικά, αυτό συνδυάζει την ταχύτητα της μηχανής με την ανθρώπινη κρίση. Στην πράξη, οι περισσότερες startup το εφάρμοσαν ως μια καθολική πολιτική παρά ως μια σταθμισμένη απόφαση, και αυτή η διάκριση είναι το σημείο όπου αρχίζει η κατάρρευση της παραγωγικότητας.

Η λογική της υιοθέτησης ήταν εύλογη εκείνη την εποχή. Τα πρώιμα αποτελέσματα της AI ήταν ασυνεπή. Οι ρυθμιστικές αρχές άρχισαν να απαιτούν ανθρώπινη λογοδοσία για τις αυτοματοποιημένες αποφάσεις. Οι ιδρυτές ήταν επιφυλακτικοί στο να εμπιστευτούν συστήματα που δεν μπορούσαν να ελέγξουν πλήρως. Το HITL φαινόταν σαν η υπεύθυνη προεπιλογή.

Το πρόβλημα είναι ότι η «υπεύθυνη προεπιλογή» έγινε «καθολική απαίτηση», η οποία δεν εφαρμοζόταν μόνο σε αποφάσεις υψηλού ρίσκου και μη αναστρέψιμες όπου ανήκει, αλλά σε κάθε αποτέλεσμα που παράγεται από την AI, ανεξάρτητα από το προφίλ κινδύνου του. Όταν συμβαίνει αυτό, η AI δεν εξαλείφει τα σημεία συμφόρησης, αλλά τα μεταφέρει παρακάτω, στην ουρά επιθεώρησής σας, όπου σιωπηλά συσσωρεύονται.

Η Υπόσχεση Παραγωγικότητας έναντι της Πραγματικότητας της Παραγωγικότητας

Το χάσμα ανάμεσα στο πόσο οι ιδρυτές αναμένουν ότι η AI θα επιταχύνει τις ομάδες τους και στο τι συμβαίνει στην πραγματικότητα σε επιχειρησιακό επίπεδο είναι πλέον μετρήσιμο, και οι αριθμοί είναι χειρότεροι από ό,τι οι περισσότεροι άνθρωποι έχουν συνειδητοποιήσει.

Σε μια τυχαιοποιημένη ελεγχόμενη δοκιμή που δημοσιεύθηκε στο arXiv τον Ιούλιο του 2025, ερευνητές από το METR μελέτησαν 16 έμπειρους προγραμματιστές που ολοκλήρωσαν 246 πραγματικές εργασίες χρησιμοποιώντας το Cursor Pro με το Claude 3.5/3.7 Sonnet. Πριν από τη μελέτη, οι προγραμματιστές προέβλεψαν ότι η AI θα μείωνε τον χρόνο ολοκλήρωσής τους κατά 24%. Αφού την ολοκλήρωσαν, εκτίμησαν μια μείωση κατά 20%. Το πραγματικό μετρούμενο αποτέλεσμα:

Τα εργαλεία AI αύξησαν τον χρόνο ολοκλήρωσης κατά 19%. Οι προγραμματιστές ήταν πιο αργοί με την AI παρά χωρίς αυτήν.

Αυτό που καθιστά αυτό το εύρημα σημαντικό δεν είναι ο ίδιος ο αριθμός, είναι το χάσμα αντίληψης. Οι προγραμματιστές πίστευαν ότι η AI τους βοηθούσε. Ο μηχανισμός είναι προβλέψιμος μόλις τον κατανοήσετε:

Η AI επιταχύνει το μέρος της εργασίας που μοιάζει με εργασία, δημιουργώντας αποτελέσματα, ενώ η επικύρωση, η διόρθωση, η ενσωμάτωση και η επιθεώρηση που ακολουθούν επεκτείνονται για να απορροφήσουν τα οφέλη.

Η έρευνα της Faros Engineering επιβεβαιώνει το μοτίβο σε μεγάλη κλίμακα. Οι μεμονωμένοι προγραμματιστές ολοκλήρωσαν 21% περισσότερες εργασίες όταν χρησιμοποιούσαν εργαλεία κωδικοποίησης AI. Αλλά ο χρόνος επιθεώρησης αυξήθηκε κατά 91%, επειδή οι ομάδες δημιουργούσαν 98% περισσότερα pull requests. Τα οφέλη παραγωγικότητας δεν εξαφανίστηκαν, μεταφέρθηκαν στο επίπεδο της επιθεώρησης, όπου περίμεναν έναν πεπερασμένο αριθμό ανθρώπινων ματιών.

Η AI δεν έκανε αυτές τις ομάδες ταχύτερες. Έκανε το σημείο συμφόρησής τους λιγότερο ορατό.

Πώς φαίνεται αυτό στην πράξη: Ένα σενάριο για μια ομάδα περιεχομένου

Φανταστείτε μια startup δώδεκα ατόμων με μια λειτουργία περιεχομένου και υποστήριξης που έχει ενσωματώσει την AI σε τρεις ροές εργασίας:

- σύνταξη τεκμηρίωσης για πελάτες

- δημιουργία αρχικών απαντήσεων υποστήριξης

- παραγωγή εσωτερικών ενημερωτικών σημειωμάτων προϊόντων

Στα χαρτιά, η ομάδα φαίνεται παραγωγική. Τα προσχέδια της AI είναι έτοιμα σε λίγα λεπτά και ο όγκος παραγωγής έχει διπλασιαστεί. Η ηγεσία το επισημαίνει ως μια ξεκάθαρη νίκη της AI.

Κάτω από την επιφάνεια: κάθε προσχέδιο δρομολογείται σε έναν άνθρωπο επιθεωρητή πριν πάει οπουδήποτε. Ο υπεύθυνος τεκμηρίωσης εγκρίνει την τεκμηρίωση. Ο διευθυντής υποστήριξης επιθεωρεί κάθε απάντηση της AI πριν φτάσει στον πελάτη. Ο επικεφαλής του προϊόντος υπογράφει κάθε ενημερωτικό σημείωμα. Καθένας από αυτούς τους ανθρώπους ξοδεύει πλέον 60-90 λεπτά την ημέρα στην επιθεώρηση της AI που δεν υπήρχε πριν από έξι μήνες.

Ελέγξτε το ποσοστό αποδοχής. Είναι 94%. Για κάθε εκατό αποτελέσματα που παράγονται από την AI, έξι τροποποιούνται. Τα υπόλοιπα ενενήντα τέσσερα περνούν ανέγγιχτα, αφού έχουν καταναλώσει τον χρόνο, την προσοχή και το πλαίσιο του επιθεωρητή.

Αυτό δεν είναι εποπτεία. Αυτό είναι καθυστέρηση με επιπλέον βήματα.

Η ομάδα δεν έχει κερδίσει σε δυναμικότητα. Έχει μετατοπίσει τη δυναμικότητα από τη δημιουργία στην έγκριση και το ονόμασε υιοθέτηση της AI.

Γιατί η ανθρώπινη επιθεώρηση δεν εντοπίζει αξιόπιστα τα λάθη της AI

Η ανθρώπινη επιθεώρηση δεν βελτιώνει την ποιότητα των αποτελεσμάτων της AI με τον τρόπο που υποθέτουν οι ιδρυτές. Στα περισσότερα πλαίσια ροών εργασίας, δημιουργεί την εμφάνιση μιας πύλης ποιότητας χωρίς να λειτουργεί ως τέτοια. Ο λόγος είναι δομικός, όχι παρακινητικός, και η κατανόηση της δομής είναι αυτό που το καθιστά διορθώσιμο.

Όταν ένας άνθρωπος επιθεωρεί ένα αποτέλεσμα που έχει δημιουργηθεί από την AI, δεν το αξιολογεί από μια ουδέτερη αφετηρία. Συναντά το αποτέλεσμα αφού η AI έχει ήδη πλαισιώσει το πρόβλημα, έχει επιλέξει τις πληροφορίες που παρουσιάζονται και έχει δομήσει το συμπέρασμα.

Η δουλειά του επιθεωρητή, σε εκείνο το σημείο, είναι να βρει λάθη σε ένα επιχείρημα που έχει ήδη συναρμολογηθεί γι' αυτόν. Αυτό είναι ένα θεμελιωδώς διαφορετικό γνωστικό έργο από την ανεξάρτητη παραγωγή της κρίσης, και είναι ένα έργο που οι άνθρωποι εκτελούν ανεπαρκώς, με συνέπεια, σε όλους τους τομείς.

Μια συστηματική ανασκόπηση του 2025 στο AI & Society (Springer Nature), εξετάζοντας 35 μελέτες με αξιολόγηση από ομοτίμους στους τομείς της υγειονομικής περίθαλψης, των χρηματοοικονομικών, της εθνικής ασφάλειας και της δημόσιας διοίκησης, επιβεβαιώνει αυτό το μοτίβο:

Οι άνθρωποι συμφωνούν με λανθασμένες συστάσεις της AI σε σημαντικά ποσοστά, και οι συνήθεις προσπάθειες μετριασμού δεν βοηθούν. Η παροχή πολλαπλών μορφών εξήγησης δεν έκανε καμία διαφορά. Η ανατροφοδότηση για τη βαθμονόμηση της εμπιστοσύνης δεν έκανε καμία διαφορά. Οι απλοϊκές εξηγήσεις, του είδους που παρέχουν τα περισσότερα εργαλεία των startup, έκαναν τους επιθεωρητές πιο ευάλωτους σε λανθασμένα αποτελέσματα της AI, όχι λιγότερο.

Το δεύτερο επίπεδο του προβλήματος είναι βαθύτερο. Οι βρόχοι ανατροφοδότησης ανθρώπου-AI όχι μόνο αποτυγχάνουν να διορθώσουν τη μεροληψία, αλλά την ενισχύουν ενεργά. Έρευνα που δημοσιεύθηκε στο Nature Human Behaviour (Glickman & Sharot, 2024) διαπίστωσε ότι οι αλληλεπιδράσεις ανθρώπου-AI ενισχύουν τη μεροληψία περισσότερο από ό,τι οι αλληλεπιδράσεις ανθρώπου-ανθρώπου.

Ο επιθεωρητής δεν είναι ένας έλεγχος στο σύστημα. Είναι μέρος του συστήματος, και το σύστημα κάμπτει την κρίση του χωρίς να το αντιλαμβάνεται.

Αυτός είναι ο λόγος για τον οποίο το ποσοστό αποδοχής 94% στο παραπάνω σενάριο δεν είναι σημάδι ότι μια ομάδα κάνει καλά τη δουλειά της. Είναι σημάδι μιας ομάδας που έχει απορροφηθεί σε έναν βρόχο ανατροφοδότησης που νομίζει ότι ελέγχει.

Δεν μπορείτε να αναθέσετε την κρίση σε ένα βήμα επιθεώρησης που η μεροληψία αυτοματισμού έχει ήδη υπονομεύσει.

Η Παγίδα της Μεροληψίας Αυτοματισμού: Σιγουριά προς τη Λάθος Κατεύθυνση

Να τι συμβαίνει στην πραγματικότητα όταν ο διευθυντής υποστήριξής σας επιθεωρεί την ενενηκοστή τέταρτη απάντηση της AI της εβδομάδας:

δεν την αξιολογούν. Την αντιστοιχίζουν με τις προηγούμενες ενενήντα τρεις και την εγκρίνουν επειδή μοιάζει ίδια. Το βήμα της επιθεώρησης υπάρχει στα χαρτιά. Ο εξονυχιστικός έλεγχος όχι.

Αυτό είναι μεροληψία αυτοματισμού, όχι αμέλεια, όχι ανικανότητα, αλλά μια προβλέψιμη γνωστική απόκριση στην εργασία παράλληλα με αυτοματοποιημένα συστήματα σε υψηλή συχνότητα. Όταν τα αποτελέσματα είναι ως επί το πλείστον σωστά και ο όγκος των εργασιών είναι υψηλός, ο εξονυχιστικός έλεγχος υποβαθμίζεται. Ο εγκέφαλος του επιθεωρητή βελτιστοποιείται για τη διεκπεραίωση. Πρέπει να το κάνει.

Αυτό που το καθιστά ιδιαίτερα επιζήμιο στις ροές εργασίας των startup είναι η μη γραμμικότητα του τρόπου αποτυχίας. Έρευνα των Horowitz και Kahn, που δημοσιεύθηκε στο International Studies Quarterly (Oxford Academic, 2024), διαπίστωσε ότι οι άνθρωποι είναι υπερβολικά σίγουροι για την AI υπό συνθήκες ρουτίνας και χαμηλότερου ρίσκου, και τείνουν στην αποστροφή προς τον αλγόριθμο, απορρίπτοντας ακόμη και σωστά αποτελέσματα της AI, όταν το διακύβευμα μοιάζει υψηλό.

Οι περισσότερες ροές εργασίας των startup ζουν μόνιμα στην πρώτη κατηγορία: αποφάσεις υψηλής συχνότητας, χαμηλότερου ρίσκου που εκπαιδεύουν τους επιθεωρητές να εγκρίνουν, έτσι ώστε όταν φτάσει το πραγματικά σημαντικό αποτέλεσμα, η συνήθεια να έχει ήδη εδραιωθεί.

Η βαθύτερη συνέπεια είναι η υποβάθμιση των δεξιοτήτων. Η ικανότητα εντοπισμού ενός λάθους της AI απαιτεί εξειδίκευση στον τομέα, αυτού του είδους που προέρχεται από την ανεξάρτητη εκτέλεση της εργασίας, όχι από την έγκριση αποτελεσμάτων που κάποιος άλλος συνέθεσε. Όσο πιο συχνά η ομάδα σας επικυρώνει αντί να δημιουργεί, τόσο λιγότερο ικανή γίνεται σε αυτό ακριβώς που εξαρτάται η διαδικασία επιθεώρησής σας.

Ο μηχανισμός εποπτείας γίνεται λιγότερο αξιόπιστος ακριβώς επειδή χρησιμοποιείται τόσο συχνά. Αυτή είναι η παγίδα που κλείνει.

Το Πραγματικό Κόστος: Πού Πάει ο Χρόνος και Γιατί Παραμένει Κρυφό

Οι περισσότεροι ιδρυτές μετρούν την παραγωγικότητα της AI στο σημείο δημιουργίας του αποτελέσματος, το μόνο σημείο όπου τα οφέλη είναι άμεσα και αποδόσιμα. Το κόστος κατανέμεται στα επίπεδα επιθεώρησης, διόρθωσης, ενσωμάτωσης και συντονισμού που ακολουθούν, και συσσωρεύεται σε σημεία που δεν εμφανίζονται στον πίνακα ελέγχου.

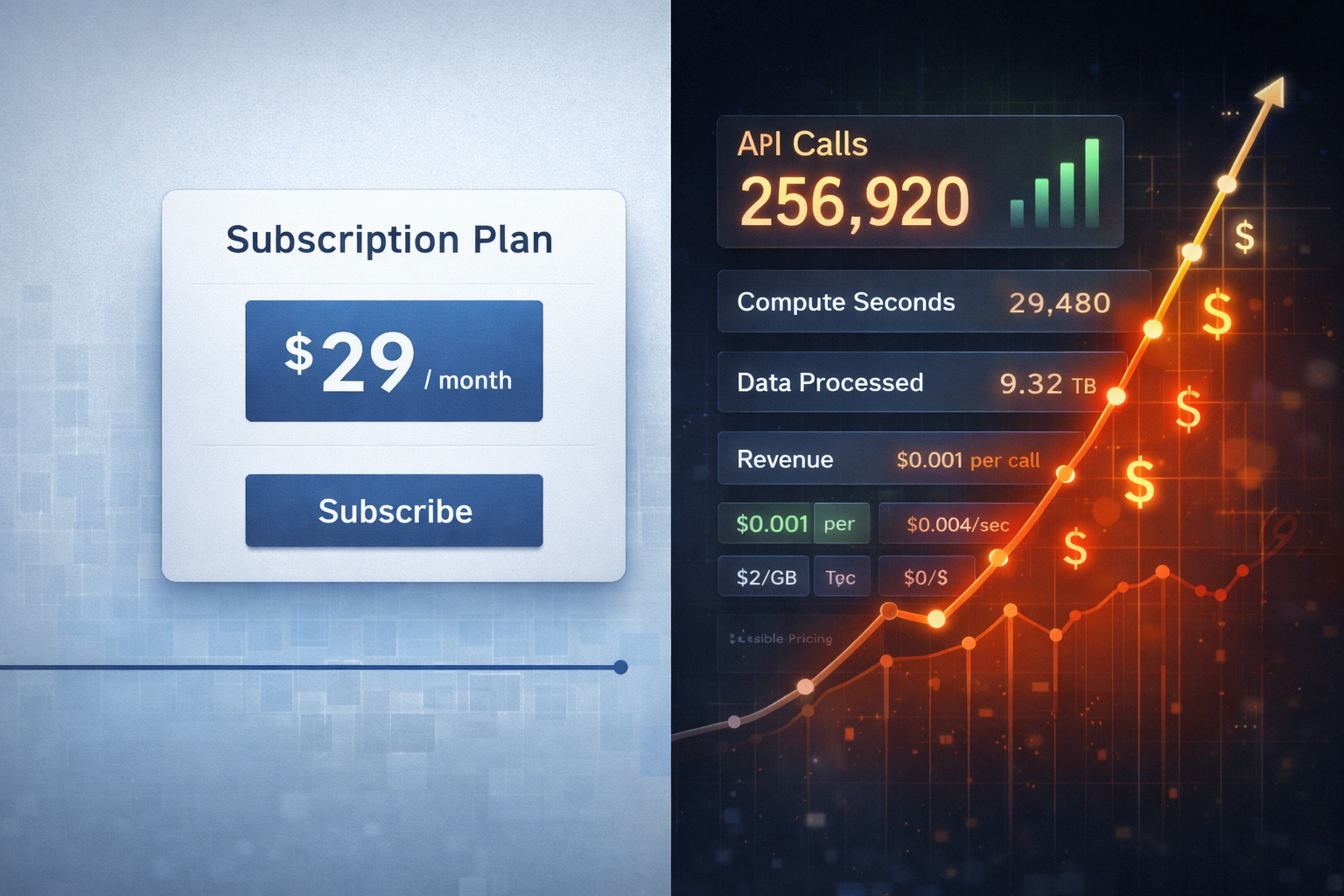

Η συγγραφή κώδικα καταλαμβάνει περίπου το 30% του χρόνου ενός προγραμματιστή. Το υπόλοιπο 70% είναι η επιθεώρηση, οι συναντήσεις, η αποσφαλμάτωση, οι δοκιμές και ο συντονισμός. Εάν η AI μειώσει το τμήμα της κωδικοποίησης στο μισό, το θεωρητικό όφελος παραγωγικότητας είναι περίπου 15%, αλλά μόνο εάν το υπόλοιπο 70% παραμείνει σταθερό. Η Faros Engineering διαπίστωσε ότι η εναλλαγή πλαισίου (context switching) αυξάνεται κατά 47% όταν οι προγραμματιστές χρησιμοποιούν εντατικά την AI, καθώς οι παράλληλες ροές εργασίας πολλαπλασιάζονται. Το κέρδος του 15% απορροφάται πριν φτάσει στο τελικό αποτέλεσμα.

Η έρευνα Stack Overflow 2025 Developer Survey διαπίστωσε ότι η θετική γνώμη για τα εργαλεία AI μειώθηκε από πάνω από 70% το 2023-2024 σε 60% το 2025. Το σαράντα έξι τοις εκατό των προγραμματιστών δυσπιστούσε στην ακρίβεια της AI. Καθώς η εμπειρία συσσωρεύεται, το αόρατο κόστος -η αποσφαλμάτωση των σφαλμάτων που παράγονται από την AI, η διαχείριση των διογκωμένων ουρών επιθεώρησης, η ανάκαμψη από τις εναλλαγές πλαισίου- διαβρώνει την αρχική αίσθηση της υιοθέτησης.

Η απώλεια παραγωγικότητας είναι πραγματική. Απλώς δεν εμφανίζεται στη μέτρηση που παρακολουθείτε.

Τι διευκρινίζει ο νόμος της ΕΕ για την τεχνητή νοημοσύνη (EU AI Act) σχετικά με την κατάλληλη εποπτεία

Ο νόμος EU AI Act, ο οποίος θα είναι εκτελεστός για τις περισσότερες υποχρεώσεις από τον Αύγουστο του 2026, καθιερώνει ένα πλαίσιο διαβαθμισμένου κινδύνου για την ανθρώπινη εποπτεία, το οποίο είναι διδακτικό ακόμη και για εταιρείες εκτός της δικαιοδοσίας της ΕΕ. Τα συστήματα AI υψηλού κινδύνου, στην πιστοληπτική βαθμολόγηση, την απασχόληση, την εκπαίδευση, την επιβολή του νόμου, τις κρίσιμες υποδομές, απαιτούν τεκμηριωμένους μηχανισμούς ανθρώπινης εποπτείας. Οι εφαρμογές χαμηλότερου κινδύνου δεν έχουν τις ίδιες απαιτήσεις.

Η ρυθμιστική λογική αντικατοπτρίζει την επιχειρησιακή: η ένταση της εποπτείας πρέπει να κλιμακώνεται ανάλογα με τη σοβαρότητα των συνεπειών. Ο νόμος απορρίπτει σιωπηρά την καθολική εφαρμογή του HITL ως στρατηγική συμμόρφωσης, επειδή η καθολική εφαρμογή του HITL δεν είναι διαχείριση κινδύνου, είναι γραφειοκρατία που δημιουργεί την εμφάνιση ελέγχου χωρίς τη λειτουργία του.

Η ψευδαίσθηση του ελέγχου είναι πιο επικίνδυνη από την έλλειψη ελέγχου. Τουλάχιστον η έλλειψη ελέγχου σε αναγκάζει να είσαι ειλικρινής για το πού βρίσκεται πραγματικά ο κίνδυνος.

Ένα πρακτικό πλαίσιο για να ξεφύγετε από την παγίδα

Η λύση δεν είναι η αφαίρεση των ανθρώπων από τις σημαντικές αποφάσεις, αλλά ο έλεγχος του πού βρίσκονται οι τρέχουσες απαιτήσεις επιθεώρησής σας στο φάσμα κινδύνου-συνεπειών, και η ειλικρίνεια σχετικά με το τι προσφέρει αυτή η επιθεώρηση.

1. Ταξινομήστε τις ροές εργασίας AI σας ανάλογα με το προφίλ απόφασης.

Για κάθε ροή εργασίας, θέστε τέσσερις ερωτήσεις. Είναι το αποτέλεσμα μη αναστρέψιμο ή δαπανηρό να αντιστραφεί; Επιφέρει ρυθμιστική ή νομική ευθύνη; Επηρεάζει άμεσα εξωτερικούς ενδιαφερόμενους; Είναι το ποσοστό σφάλματος της AI σε αυτόν τον τομέα άγνωστο ή γνωστό ότι είναι υψηλό; Οι ροές εργασίας που βαθμολογούνται υψηλά σε οποιαδήποτε από αυτές τις διαστάσεις δικαιολογούν δομημένη ανθρώπινη επιθεώρηση. Οι ροές εργασίας που βαθμολογούνται χαμηλά και στις τέσσερις είναι υποψήφιες για «εμπιστοσύνη με παρακολούθηση».

2. Μετρήστε το πραγματικό ποσοστό αποδοχής σας.

Εάν οι επιθεωρητές σας εγκρίνουν τα αποτελέσματα της AI χωρίς τροποποίηση σε ποσοστό άνω του 90%, η επιθεώρηση δεν λειτουργεί ως ποιοτικός έλεγχος, αλλά ως καθυστέρηση. Αφαιρέστε την υποχρεωτική επιθεώρηση από αυτές τις ροές εργασίας. Δεν εξαλείφετε την εποπτεία, εξαλείφετε το θέατρο.

3. Εισαγάγετε στατιστική δειγματοληψία αντί για καθολική επιθεώρηση.

Για ροές εργασίας μεσαίου κινδύνου και υψηλής συχνότητας, μεταβείτε από την επιθεώρηση του 100% των αποτελεσμάτων στην επιθεώρηση ενός τυχαιοποιημένου 10-15%. Αυτό διατηρεί την ικανότητά σας να ανιχνεύετε συστηματικά σφάλματα και αποκλίσεις χωρίς να καταναλώνετε ανάλογο ανθρώπινο χρόνο. Τα περισσότερα ζητήματα ποιότητας είναι μοτίβα, όχι μεμονωμένα γεγονότα, και η δειγματοληψία τα βρίσκει γρηγορότερα από τους εξαντλημένους επιθεωρητές που επιθεωρούν τα πάντα.

4. Δημιουργήστε μηχανισμό επαναφοράς (rollback), όχι έγκρισης.

Για αποτελέσματα χαμηλού κινδύνου, προχωρήστε σε αυτόματη αποστολή με μηχανισμό επαναφοράς (rollback) αντί για ένα βήμα προ-έγκρισης. Το κόστος ενός κακού αποτελέσματος στα περισσότερα από αυτά τα πλαίσια είναι χαμηλότερο από το συσσωρευμένο κόστος της επιθεώρησης κάθε αποτελέσματος. Αλλάξτε τη στάση της εποπτείας σας από προληπτική σε αποκριτική.

Η επιχειρησιακή ευρετική μέθοδος:

«Αν μπορείτε να διορθώσετε ένα σφάλμα εκ των υστέρων σε λιγότερο από δέκα λεπτά, πιθανότατα δεν θα έπρεπε να απαιτείται καθόλου ανθρώπινη έγκριση εκ των προτέρων».

Η Παραγωγική Εκδοχή του Human-in-the-Loop

Η ανθρώπινη εποπτεία της AI δεν είναι λάθος. Εφαρμοσμένη στις σωστές αποφάσεις -μη αναστρέψιμες, υψηλού ρίσκου, με εξωτερικές συνέπειες, νομικά υπεύθυνες- είναι ένα από τα πιο σημαντικά διαθέσιμα εργαλεία διαχείρισης κινδύνου.

Η έρευνα δεν επιχειρηματολογεί κατά της ανθρώπινης κρίσης, αλλά κατά της εφαρμογής της ανθρώπινης κρίσης σε πλαίσια όπου προσθέτει τριβή χωρίς να προσθέτει ακρίβεια.

Οι startup που λειτουργούν αποτελεσματικά με την AI το 2026 δεν είναι εκείνες που αφαίρεσαν τους ανθρώπους από τις ροές εργασίας τους. Είναι εκείνες που σταμάτησαν να αντιμετωπίζουν τη φράση «ένας άνθρωπος το έλεγξε» ως τον ορισμό της ασφάλειας, και άρχισαν να αναρωτιούνται τι κοστίζει πραγματικά αυτός ο έλεγχος και τι πραγματικά εντοπίζει.

Οι περισσότερες startup δεν χρησιμοποιούν το HITL ως έλεγχο κινδύνου. Το χρησιμοποιούν ως δεκανίκι, έναν τρόπο να αισθάνονται ότι ελέγχουν συστήματα που δεν εμπιστεύονται πλήρως, σε αντάλλαγμα για τα οφέλη παραγωγικότητας που υποτίθεται ότι θα παρείχαν αυτά τα συστήματα.

Εάν οι επιθεωρητές σας εγκρίνουν το 90% των αποτελεσμάτων χωρίς αλλαγές, δεν σας προστατεύουν. Είναι απλώς το τελευταίο μέρος όπου ζει το σημείο συμφόρησής σας πριν το παρατηρήσετε.

Το ερώτημα που αξίζει να εξεταστεί δεν είναι «πρέπει οι άνθρωποι να βρίσκονται σε αυτόν τον βρόχο;». Το ερώτημα είναι:

«τι θα έπρεπε να πιστεύετε για αυτό το αποτέλεσμα της AI, και για τον επιθεωρητή σας, ώστε αυτό το βήμα επιθεώρησης να αξίζει τον κόπο;»

Απαντήστε σε αυτό με ειλικρίνεια για κάθε ροή εργασίας που εκτελείτε, και η αρχιτεκτονική γράφεται από μόνη της.

Πηγές

- METR, "Measuring the Impact of Early-2025 AI on Experienced Open-Source Developer Productivity", arXiv, July 2025: arxiv.org

- Romeo & Conti, "Exploring Automation Bias in Human-AI Collaboration: A Review and Implications for Explainable AI", AI & Society, Springer Nature, July 2025: link.springer.com

- Glickman, M. & Sharot, T., "How Human-AI Feedback Loops Alter Human Perceptual, Emotional and Social Judgements", Nature Human Behaviour, 2024: doi.org

- Horowitz, M.C. & Kahn, L., "Bending the Automation Bias Curve: A Study of Human and AI-Based Decision Making in National Security Contexts", International Studies Quarterly, Oxford Academic, June 2024: academic.oup.com

- Agudo, U. et al., "The Impact of AI Errors in a Human-in-the-Loop Process", Cognitive Research: Principles and Implications, PubMed, January 2024: pubmed.ncbi.nlm.nih.gov

- Beck, J. et al., "Bias in the Loop: How Humans Evaluate AI-Generated Suggestions", arXiv, September 2025: arxiv.org

- Stanford HAI, "The 2025 AI Index Report", Stanford University Human-Centered Artificial Intelligence, 2025: hai.stanford.edu

- Mahlow, P., Züger, T. & Kauter, L., "KI unter Aufsicht: Brauchen wir 'Humans in the Loop' in Automatisierungsprozessen?", HIIG Digital Society Blog / Humboldt Institute for Internet and Society, 2024: hiig.de

- TDWI, "The Role of Human-in-the-Loop in AI-Driven Data Management", September 2025: tdwi.org

- National Institute of Standards and Technology (NIST), "Artificial Intelligence Risk Management Framework (AI RMF 1.0)", U.S. Department of Commerce, 2023: nist.gov